Bruxelles – La prima legislazione al mondo sull’intelligenza artificiale è entrata nelle ultime battute dei negoziati inter-istituzionali tra il Parlamento e il Consiglio dell’Ue. È la fase più delicata, quella in cui i punti di contrasto maggiore rimasti vanno risolti per arrivare a un’intesa politica che soddisfi entrambi i co-legislatori, mentre la fine della legislatura si avvicina ogni giorno di più. Ma per tutti i responsabili dei dossier digitali e tecnologici della Commissione Europea l’obiettivo è uno: chiudere i triloghi entro la fine dell’anno.

A pochi giorni dalle indiscrezioni della vicepresidente dell’esecutivo Ue responsabile per il Digitale, Věra Jourová, al Summit sulla sicurezza dell’intelligenza artificiale a Bletchley Park, anche il commissario per il Mercato interno, Thierry Breton, ha assicurato nel corso della sua visita di oggi (10 novembre) in Cina che “abbiamo ancora due o tre triloghi per cercare di finalizzare il Regolamento entro la fine del 2023“. Se a queste si incrociano anche le parole della presidente della Commissione, Ursula von der Leyen, al primo vertice internazionale sull’Ia nel Regno Unito – “è ora nelle fasi finali del processo legislativo” – emerge abbastanza chiaramente come il Berlaymont stia puntando tutte le sue carte sulla chiusura dei lavori tecnici e politici nel giro del prossimo mese e mezzo. Con un accordo politico prima di Natale si potrebbero programmare per inizio del 2024 gli appuntamenti nelle singole istituzioni comunitarie per il via libera definitivo, in tempo per pubblicare in Gazzetta Ufficiale dell’Ue il nuovo Regolamento prima che scada la legislatura in primavera, a tre anni dalla presentazione della proposta da parte della Commissione.

A pochi giorni dalle indiscrezioni della vicepresidente dell’esecutivo Ue responsabile per il Digitale, Věra Jourová, al Summit sulla sicurezza dell’intelligenza artificiale a Bletchley Park, anche il commissario per il Mercato interno, Thierry Breton, ha assicurato nel corso della sua visita di oggi (10 novembre) in Cina che “abbiamo ancora due o tre triloghi per cercare di finalizzare il Regolamento entro la fine del 2023“. Se a queste si incrociano anche le parole della presidente della Commissione, Ursula von der Leyen, al primo vertice internazionale sull’Ia nel Regno Unito – “è ora nelle fasi finali del processo legislativo” – emerge abbastanza chiaramente come il Berlaymont stia puntando tutte le sue carte sulla chiusura dei lavori tecnici e politici nel giro del prossimo mese e mezzo. Con un accordo politico prima di Natale si potrebbero programmare per inizio del 2024 gli appuntamenti nelle singole istituzioni comunitarie per il via libera definitivo, in tempo per pubblicare in Gazzetta Ufficiale dell’Ue il nuovo Regolamento prima che scada la legislatura in primavera, a tre anni dalla presentazione della proposta da parte della Commissione.

I lavori intanto procedono, con l’ultimo trilogo svoltosi lo scorso 24 ottobre e i negoziati tecnici che si susseguono a ritmo incessante in vista del prossimo appuntamento tra i responsabili politici dell’Eurocamera e del Consiglio dell’Ue il 6 dicembre. È questa la data da cerchiare in rosso nel calendario, in cui si potrebbe giungere a un’intesa politica. Ma al momento ci sono tre capitoli cruciali su cui serve un lavoro di mediazione intenso: norme di classificazione per i sistemi ‘ad alto rischio’, applicazione della legge e modelli generativi di intelligenza artificiale. In un Regolamento basato su un approccio su quattro livelli di rischio, è il ‘rischio alto’ a porre le sfide maggiori per gli obblighi da rispettare: la Commissione potrebbe essere incaricata di sviluppare un elenco completo di esempi pratici di casi di ‘alto rischio’, anche se i co-legislatori sono ancora divisi su quanto alta porre l’asticella.

I lavori intanto procedono, con l’ultimo trilogo svoltosi lo scorso 24 ottobre e i negoziati tecnici che si susseguono a ritmo incessante in vista del prossimo appuntamento tra i responsabili politici dell’Eurocamera e del Consiglio dell’Ue il 6 dicembre. È questa la data da cerchiare in rosso nel calendario, in cui si potrebbe giungere a un’intesa politica. Ma al momento ci sono tre capitoli cruciali su cui serve un lavoro di mediazione intenso: norme di classificazione per i sistemi ‘ad alto rischio’, applicazione della legge e modelli generativi di intelligenza artificiale. In un Regolamento basato su un approccio su quattro livelli di rischio, è il ‘rischio alto’ a porre le sfide maggiori per gli obblighi da rispettare: la Commissione potrebbe essere incaricata di sviluppare un elenco completo di esempi pratici di casi di ‘alto rischio’, anche se i co-legislatori sono ancora divisi su quanto alta porre l’asticella.

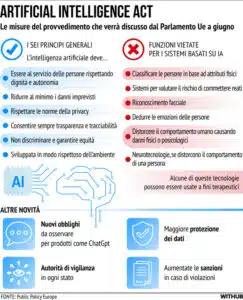

A proposito dell’applicazione della legge, è intenso il negoziato sulle applicazioni di intelligenza artificiale da proibire e quelle che possono essere affidate alle forze dell’ordine. Su questo punto c’è molta divergenza tra i co-legislatori, soprattutto perché il Parlamento Europeo è stato netto sull’urgenza di vietare sistemi di identificazione biometrica remota in spazi pubblici, software di riconoscimento delle emozioni e sistemi di polizia predittivi, che potrebbero avere un pesante impatto sui diritti fondamentali dei cittadini. E infine c’è l’enorme capitolo dei modelli generativi di intelligenza artificiale – come ChatGPT – che è diventato un tema urgente all’interno del futuro Regolamento Ue nell’ultimo anno. La soluzione potrebbe essere quella di inserire obblighi orizzontali su trasparenza e supporto agli operatori economici, anche se deve essere definito con precisione il livello dei modelli ‘molto capaci’ sul piano delle verifiche e delle misure di mitigazione del rischio.

Le basi del Regolamento Ue sull’intelligenza artificiale

È del 21 aprile del 2021 la proposta di un quadro normativo sull’intelligenza artificiale presentata dalla Commissione Europea per lo sviluppo e l’utilizzo di tecnologie all’avanguardia sul suolo dell’Ue. Si tratta della prima iniziativa legislativa al mondo per definire un approccio normativo sui sistemi di Ia. Sia il Consiglio sia il Parlamento Europeo hanno deciso di dare seguito all’impostazione presentata dall’esecutivo e ciò che emergerà – al netto di aggiustamenti per far convergere le posizioni delle due istituzioni – sarà una scala di rischio per regolamentare le applicazioni di intelligenza artificiale su quattro livelli: minimo (videogiochi abilitati per l’Ia e filtri anti-spam), limitato (chatbot), alto (assegnazione di punteggi a esami scolastici e professionali, smistamento dei curriculum, valutazione dell’affidabilità delle prove in tribunale, chirurgia assistita da robot) e inaccettabile (tutto ciò che rappresenta una “chiara minaccia” per la sicurezza, i mezzi di sussistenza e i diritti delle persone, come l’assegnazione di un ‘punteggio sociale’ da parte dei governi). Per il primo livello non è previsto alcun intervento, mentre l’ultimo livello sarà vietato integralmente.

I sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si sta giocando sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori- sulla spinta degli eurodeputati – sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

I sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si sta giocando sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori- sulla spinta degli eurodeputati – sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Infine, come ricordato a Bletchley Park da von der Leyen, all’interno della proposta di Regolamento Ue sull’Ia c’è anche la possibilità di creare un Ufficio europeo per l’intelligenza artificiale. “Questo Ufficio potrebbe occuparsi dei modelli di Ia più avanzati, con la responsabilità della supervisione”, ha spiegato la numero uno dell’esecutivo comunitario, precisando che dovrebbe seguire i quattro principi delineati nel suo discorso sul quadro di governance globale e far rispettare le regole comuni in tutti i 27 Stati membri per i modelli più avanzati. Dalle parole di von der Leyen è emerso che l’Ufficio Ue per l’intelligenza artificiale “dovrebbe avere anche una vocazione globale“, collaborando con enti simili in tutto il mondo.