Bruxelles – Nessuna pugnalata alle spalle dell’ultimo minuto, nessun accordo saltato proprio sul più bello. Il Regolamento sull’intelligenza artificiale supera l’ultimo ostacolo al Parlamento Ue, con una sonora sconfitta per il Partito Popolare Europeo: nella posizione approvata oggi (14 giugno) in sessione plenaria non sono passati gli emendamenti presentati all’ultimo minuto dal Ppe – rompendo il patto con gli altri gruppi politici – per escludere il riconoscimento biometrico in tempo reale dalla lista delle pratiche considerate inaccettabili nello sviluppo e utilizzo di sistemi di intelligenza artificiale. “Quello che abbiamo visto oggi è che è sempre meglio rispettare gli accordi, altrimenti si rischia di perdere la faccia”, ha commentato in modo secco al termine della votazione il co-relatore per il Parlamento Ue e capo-delegazione del Partito Democratico, Brando Benifei.

Alla vigilia del voto si era aperto lo scenario di un possibile boicottaggio del testo finale da parte degli eurodeputati popolari in caso di affossamento degli emendamenti 800, 801 e 802. L’affossamento delle proposte del Ppe c’è effettivamente stato, ma l’ordine di voto sulla posizione finale dell’Eurocamera non è stato contrario per il Ppe. Anzi, la relazione è stata approvata a larghissima maggioranza, con 499 voti a favore, 28 contrari e 93 astenuti, e “già stasera inizieremo il lavoro di consultazione con il Consiglio dell’Ue, in modo di poter concludere i lavori entro la fine della legislatura” nella primavera del prossimo anno. L’avvio dei negoziati inter-istituzionali tra Parlamento e Consiglio dell’Ue da giorni è stato calendarizzato dalla presidenza di turno svedese del Consiglio, e anche la vicepresidente esecutiva della Commissione Ue per il Digitale, Margrethe Vestager, ha confermato che “l’obiettivo è concluderli entro la fine del 2023”.

“Possiamo ottenere il meglio dall’intelligenza artificiale e cogliere le opportunità, ma dobbiamo essere sicuri di poterci fidare delle garanzie stabilite sull’identificazione dei rischi, senza esagerare con la burocrazia”, ha commentato Benifei in conferenza stampa, insieme al collega Dragoş Tudorache (Renew Europe) e alla presidente del Parlamento Ue, Roberta Metsola: “Voglio ringraziare i due co-relatori per l’enorme lavoro e per aver trovato un’impostazione equilibrata in questa legislazione che stabilirà uno standard globale”. La stessa numero uno dell’Eurocamera ha sottolineato che “vogliamo essere leader mondiali della tutela dei diritti fondamentali in questo settore legislativo“, perché “ogni volta che la tecnologia progredisce, deve farlo in linea con i nostri valori democratici, dobbiamo stabilire chiari limiti”.

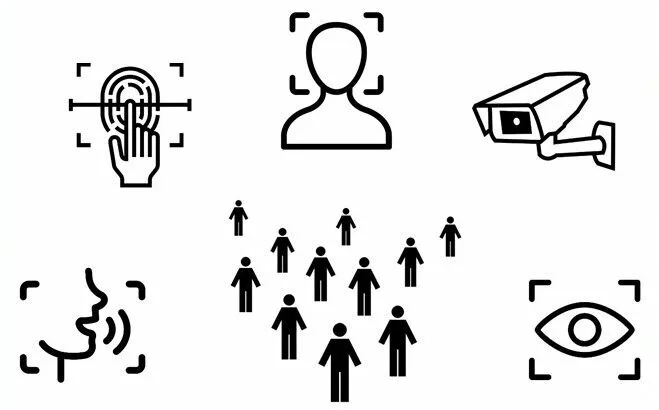

È proprio la questione del divieto di utilizzo del riconoscimento biometrico in tempo reale a tenere banco a Bruxelles. “Abbiamo proibito gli usi dell’intelligenza artificiale inaccettabili, che portano rischi insostenibili per l’Unione Europea“, ha messo in chiaro il capo-delegazione del Pd all’Eurocamera, riferendosi alla proposta del Ppe sulla deroga negli spazi pubblici “qualora sia strettamente necessario per la ricerca mirata di persone scomparse, compresi i minori, la prevenzione di un attacco terroristico e l’identificazione degli autori di reati punibili nello Stato membro interessato per un periodo massimo di almeno tre anni”. Per i due co-relatori si trattava in ogni caso di “rischio di sorveglianza di massa”, anche se “è stata lasciata la possibilità non in tempo reale per perseguire determinati reati e crimini“. A poche ore dall’inizio dei triloghi con il Consiglio dell’Ue, per Benifei “forse ci troviamo in una posizione ancora più forte, perché abbiamo evitato la sorveglianza di massa e vogliamo mantenere questo ampio sostegno nei negoziati”. Un punto connesso al riconoscimento biometrico riguarda infine l’utilizzo dei sistemi di intelligenza artificiale nella gestione della migrazione: “Siamo in un ambito di grande rischio e la cosa va presa con grande serietà, dobbiamo rimanere vigili per garantire il rispetto dei diritti fondamentali”, ha spiegato Benifei. Il collega Tudorache ha poi sottolineato che il Regolamento sull’intelligenza artificiale “deve essere applicato anche nella gestione delle frontiere, questo significa obblighi di trasparenza e valutazione d’impatto sui diritti umani“.

È proprio la questione del divieto di utilizzo del riconoscimento biometrico in tempo reale a tenere banco a Bruxelles. “Abbiamo proibito gli usi dell’intelligenza artificiale inaccettabili, che portano rischi insostenibili per l’Unione Europea“, ha messo in chiaro il capo-delegazione del Pd all’Eurocamera, riferendosi alla proposta del Ppe sulla deroga negli spazi pubblici “qualora sia strettamente necessario per la ricerca mirata di persone scomparse, compresi i minori, la prevenzione di un attacco terroristico e l’identificazione degli autori di reati punibili nello Stato membro interessato per un periodo massimo di almeno tre anni”. Per i due co-relatori si trattava in ogni caso di “rischio di sorveglianza di massa”, anche se “è stata lasciata la possibilità non in tempo reale per perseguire determinati reati e crimini“. A poche ore dall’inizio dei triloghi con il Consiglio dell’Ue, per Benifei “forse ci troviamo in una posizione ancora più forte, perché abbiamo evitato la sorveglianza di massa e vogliamo mantenere questo ampio sostegno nei negoziati”. Un punto connesso al riconoscimento biometrico riguarda infine l’utilizzo dei sistemi di intelligenza artificiale nella gestione della migrazione: “Siamo in un ambito di grande rischio e la cosa va presa con grande serietà, dobbiamo rimanere vigili per garantire il rispetto dei diritti fondamentali”, ha spiegato Benifei. Il collega Tudorache ha poi sottolineato che il Regolamento sull’intelligenza artificiale “deve essere applicato anche nella gestione delle frontiere, questo significa obblighi di trasparenza e valutazione d’impatto sui diritti umani“.

La posizione del Parlamento Ue sull’intelligenza artificiale

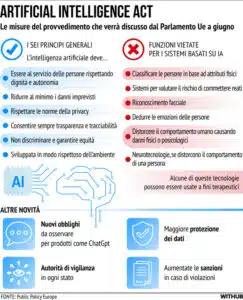

La posizione ora definitiva del Parlamento Ue sul Regolamento sull’intelligenza artificiale è incentrata sulla scala di rischio per regolamentare le applicazioni di intelligenza artificiale, su quattro livelli di rischio: minimo (videogiochi abilitati per l’Ia e filtri anti-spam), limitato (chatbot), alto (assegnazione di punteggi a esami scolastici e professionali, smistamento dei curriculum, valutazione dell’affidabilità delle prove in tribunale, chirurgia assistita da robot) e inaccettabile (tutto ciò che rappresenta una “chiara minaccia per la sicurezza, i mezzi di sussistenza e i diritti delle persone”, come l’assegnazione di un ‘punteggio sociale’ da parte dei governi). Per il primo livello non è previsto alcun intervento, mentre l’ultimo livello sarà vietato integralmente.

Secondo la posizione dell’Eurocamera i sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si giocherà sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori, sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Secondo la posizione dell’Eurocamera i sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si giocherà sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori, sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Per quanto riguarda l’alto rischio, gli eurodeputati hanno ampliato la classificazione prevista dall’Artificial Intelligence Act, includendo danni alla salute, alla sicurezza, ai diritti fondamentali o all’ambiente, così come sistemi di intelligenza artificiale che possono influenzare gli elettori nelle campagne politiche e nei sistemi di raccomandazione utilizzati dalle piattaforme di social media (secondo quanto previsto dal Digital Services Act). Nell’uso generale dei sistemi Ia, i fornitori dovranno garantire una solida protezione dei diritti fondamentali, ridurre i rischi e rispettare i requisiti di progettazione, registrandosi nella banca dati dell’Ue. A proposito dei modelli di fondazione generativa come ChatGpt, gli eurodeputati chiedono il rispetto dei requisiti di trasparenza e la pubblicazione dei dati protetti da copyright utilizzati per l’addestramento. Per promuovere l’innovazione sono state invece inserite esenzioni per le attività di ricerca e per i componenti dell’IA forniti con licenze open-source. A monitorare su tutto l’impianto dell’Artificial Intelligence Act ci sarà l’Ufficio Ue per l’Ia, il cui ruolo è stato riformato dal Parlamento Ue.

![La presidente della Regione Sardegna, Alessandra Todde [foto: Andrea di Biagio/imagoeconomica]](https://www.eunews.it/wp-content/uploads/2025/04/Imagoeconomica_2131124-120x86.jpg)